Das schöne in der Wissenschaft ist, dass man sich ganz phantastische Modelle ausdenken kann und dabei seine Kreativität voll ausleben kann. Und weil es nicht nur einen Wissenschaftler gibt, sondern ganz viele, gibt es auch eine ganze Reihe von Alternativmodellen. Schlimm wird es erst, wenn der Tag der Wahrheit naht. Hefte raus Klassenarbeit. Wenn also die verschiedenen Prognosen mit den real eingetretenen Messwerten verglichen werden. Wer hatte den richtigen Riecher und wer sollte sich schleunigst ein besseres Modell einfallen lassen?

Wenn sich dann herausstellen sollte, dass alle Modelle danebenliegen, sind die Modelle falsifiziert, entpuppen sich also als wertlos. Die Überprüfbarkeit von Modellen ist ein Grundprinzip der Wissenschaft, wie bereits Richard Feynman in einem seiner legendären Vorträge erläuterte:

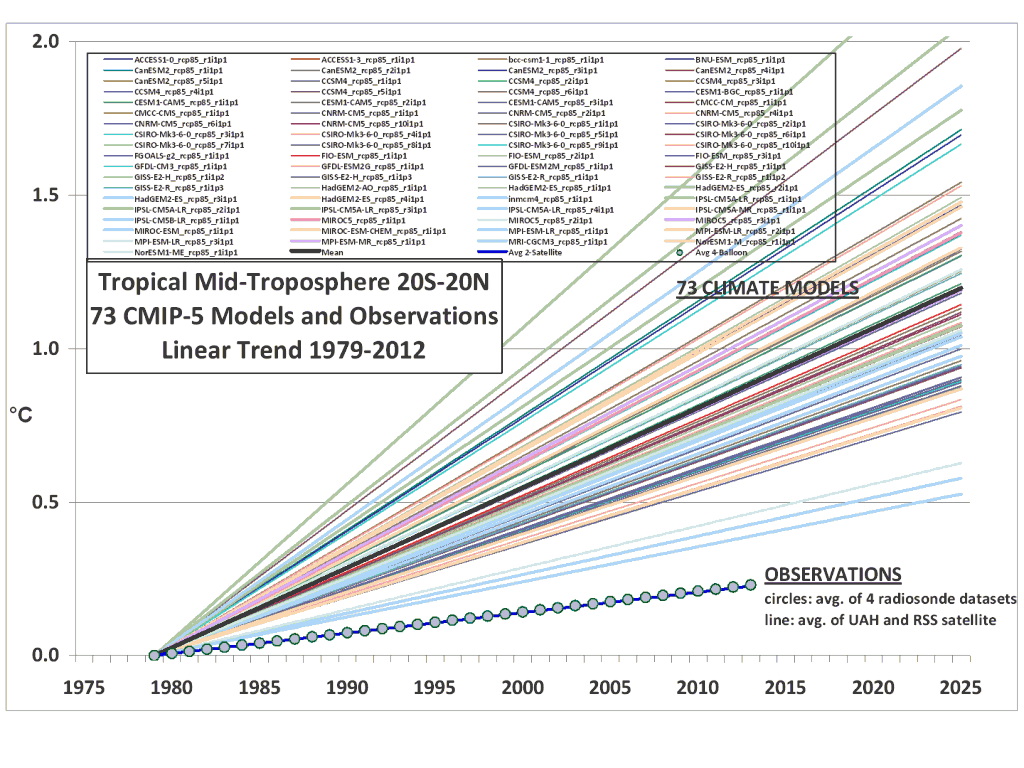

Fehlgeschlagene Hypothesen hat es in der Wissenschaft sehr oft gegeben. Eine schöne Zusammenstellung der größten Wissenschaftsflops gibt es auf WUWT. Leider gehören auch die Klimawissenschaften in diese Kategorie. Roy Spencer hat einmal eine ganze Palette von 73 Klimamodellen mit der realen Temperaturentwicklung vergleichen, und alle schossen weit überhitzt über das Ziel hinaus:

Und gleich noch so ein Fehlschlag: Im August 2009 hatten Judith Lean und David Rind in den Geophysical Research Letters eine mutige Mittelfrist-Klimaprognose gewagt. Sie hatten für den Fünfjahreszeitraum 2009 bis 2014 eine Erwärmung von 0,15°C vorhergesagt. In Wahrheit erwärmte es sich in diesem Zeitraum überhaupt nicht. Eine bittere Pleite.

In den letzten Jahren dämmerte es den Forschern, dass vielleicht doch nicht nur das i-Tüpfelchen in den Modellen fehlte. Zu offensichtlich waren die Fehlprognosen. Kein einziges der vormals hochgelobten Klimamodelle hatte den mittlerweile seit 16 Jahre anhalten Erwärmungsstopp für möglich gehalten. Im September 2011 räumten Crook & Forster in einem Artikel im Journal of Geophysical Research ein, dass die vordergründige Reproduktion der realen Temperaturentwicklung in einem Klimamodell noch lange nicht bedeutet, dass die Mechanismen vollständig verstanden wären. Zu vielfältig sind die frei einstellbaren Parameter, die in der Regel bewusst so gewählt werden, dass eine Übereinstimmung aktiv herbeigeführt wird. Eine Vorhersagekraft kann sich daher hieraus nicht automatisch ableiten. Hier ein Auszug aus der Kurzfassung von Crook & Foster (2011):

In this paper, we breakdown the temperature response of coupled ocean‐atmosphere climate models into components due to radiative forcing, climate feedback, and heat storage and transport to understand how well climate models reproduce the observed 20th century temperature record. Despite large differences between models’ feedback strength, they generally reproduce the temperature response well but for different reasons in each model.

In der Mitgliederzeitschrift der American Geophysical Union (AGU), Eos, beschäftigte sich Colin Schultz mit dem Artikel und nahm kein Blatt vor den Mund:

Climate model’s historical accuracy no guarantee of future success

To validate and rank the abilities of complex general circulation models (GCMs), emphasis has been placed on ensuring that they accurately reproduce the global climate of the past century. But because multiple paths can be taken to produce a given result, a model may get the right result but for the wrong reasons.

Die Ernüchterung hat mittlerweile auch auf die IPCC-nahen Blogs übergegriffen. In einem Gastbeitrag auf Real Climate stellten Geert Jan van Oldenborgh, Francisco Doblas-Reyes, Sybren Drijfhout und Ed Hawkins am 15. April 2013 klar, dass die im aktuellen 5. IPCC Klimazustandsbericht verwendeten Modelle für regionale Klimaprognosen gänzlich ungeeignet sind: